17 февраля 2021

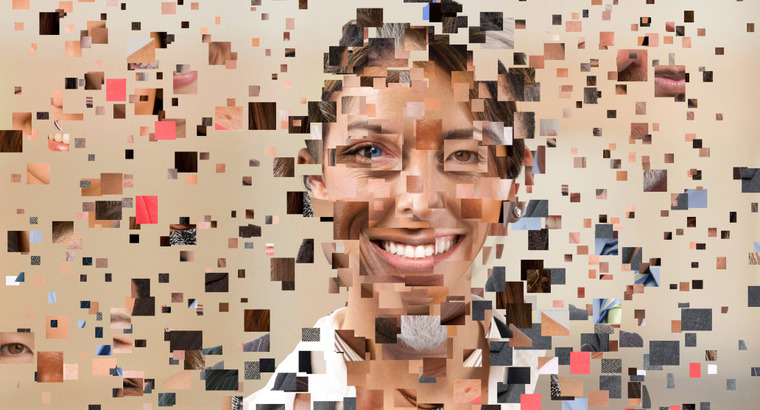

Как мы потеряли контроль над нашими лицами

В переводе статьи MIT Technology Review — о крупнейшем исследовании данных по распознаванию лиц, демонстрирующем, как развитие метода глубокого обучения в этом направлении привело к потере конфиденциальности людей.

В 1964 году математик и выдающийся специалист в области искусственного интеллекта Вудро Бледсоу впервые попытался сопоставить лица подозреваемых с фотографиями. Он измерил расстояния между различными частями лиц на отпечатанных изображениях и ввёл их в компьютерную программу. Его успехи положили начало десятилетиям исследований по обучению машин распознаванию человеческих лиц.

Свежайшая научная работа показывает, насколько негативно развитие глубокого обучения сказалось на нашей приватности. Распознавание не только играет на руку слежке — оно полностью разрушило норму получения согласия.

Дебора Раджи, член некоммерческой организации Mozilla, и Женевьева Фрид, консультант Конгресса США по вопросам контроля алгоритмов, изучили более 130 наборов данных из систем распознавания лиц, собранных за 43 года. Они обнаружили, что исследователи, нуждаясь во всё большем количестве данных глубокого обучения, постепенно отказались от запроса на согласие людей. Это привело к тому, что огромное число личных фотографий стало включаться в системы наблюдения без ведома изображённых.

Кроме того, это привело к «беспорядочным» наборам данных: в них непреднамеренно стали включаться фотографии несовершеннолетних и изображения плохого качества и использоваться расистские и сексистские подписи. Эта тенденция, пожалуй, может объяснить растущее число случаев, когда системы распознавания лиц срабатывали неправильно и приводили к таким серьёзным последствиям, как ошибочные аресты двух чернокожих мужчин в районе Детройта в прошлом году.

Поначалу люди были чрезвычайно осторожны при сборе, документировании и проверке персональных данных, говорит Раджи. Теперь, по её словам, об этом не заботятся, от этого отказались: «Ты просто не можешь отследить миллион своих изображений. А после определённого момента ты даже не можешь притворяться, что у тебя есть контроль над ними».

.

История систем распознавания лиц

.

Исследователи определили четыре основных этапа развития распознавания лиц, на каждом из которых технологию совершенствовали. Первая фаза была в период до 1990-х годов и характеризовалась большей частью применением ручных методов и медленных вычислений.

Но затем министерство обороны США выделило 6,5 млн долл. на создание первого крупномасштабного датасета с изображениями лиц. Министерство осознало, что распознавание поможет отслеживать и идентифицировать людей более эффективно, чем отпечатки пальцев. За три года в рамках проекта провели более 15 фотосессий, на которых собрали 14126 изображений 1199 человек. К 1996 году была собрана база данных FERET.

В следующем десятилетии наблюдался рост академических и коммерческих исследований распознавания лиц и создание множества новых наборов данных. Подавляющее большинство получили с помощью фотосессий, подобных FERET, и с полного согласия участников. Многие также включали в себя тщательные метаданные, сказала Раджи, такие как возраст, этническая принадлежность субъектов или информация об освещении. Но исследователи стремились к более крупным и разнообразным датасетам.

В 2007 году выпуск набора данных Labeled Faces in the Wild (LFW) открыл шлюзы для получения информации через веб-поиск. Исследователи стали загружать изображения непосредственно из Google, Flickr и Yahoo без разрешения изображённых. LFW также смягчил стандарты, касающиеся использования фотографий несовершеннолетних, собирая картинки, обозначенные как «ребёнок», «несовершеннолетний» и «подросток». За короткое время были сделаны очень крупные датасеты, однако распознавание лиц по-прежнему сталкивалось со старыми проблемами. Это снова подтолкнуло исследователей к поиску ещё большего числа методов получения данных для увеличения эффективности технологии.

В 2014 году Facebook использовал фотографии своих пользователей для Deepface. Компания так и не опубликовала датасет. Сверхчеловеческая производительность системы фактически привела глубинное обучение к анализу лиц, поскольку ручная проверка и маркировка стали почти невозможны из-за массива данных в десятки миллионов фотографий, говорит Раджи. Также это повлекло за собой автоматическую генерацию подписей с оскорбительной терминологией.

Порядок использования наборов данных начал меняться. Вместо непосредственно распознавания новые модели стали фокусироваться на классификации людей. «Это фотография Карен?» превратилось в «Давайте охарактеризуем личность Карен или её этническую принадлежность».

Директор по глобальной политике AI Now Амба Как, не участвовавшая в исследовании, говорит, что глубокое обучение, возможно, разрешило для распознавания некоторые вопросы, но технологический прогресс дался дорого. «Возникли хорошо знакомые проблемы с согласием, извлечением, интеллектуальной собственностью и конфиденциальностью».

.

Вред, который порождает вред

Раджи говорит, что серьёзно обеспокоена распознаванием лиц на основе глубокого обучения: «Это гораздо опаснее. Вы собираете конфиденциальную информацию о десятках тысяч людей, что само по себе плохо. А затем мы накапливаем всю эту информацию, которую вы не можете контролировать, и создаём что-то, что, вероятно, будет работать так, как вы даже не можете предсказать. Вот где мы сейчас находимся».

Она надеется, что её исследование подтолкнёт учёных к поиску компромисса между преимуществами глубокого обучения и потерей согласия, а также тщательной проверкой данных и тщательной документацией. «Стоило ли отказываться от всех этих практик, чтобы заниматься глубоким обучением?» — задалась вопросом Раджи.

Раджи настоятельно призывает тех, кто создаёт системы распознавания лиц, рассмотреть другие методы: «Для использования инструмента без причинения вреда людям требуется переосмыслить всё, что мы знаем о нём».

Похожие статьи

Наша рассылка

Главное за неделю в области права.

Контакты

18+

23 декабря 2022 года Минюст включил Роскомсвободу в реестр незарегистрированных общественных объединений, выполняющих функции иностранного агента. Мы не согласны с этим решением и обжалуем его в суде.