11 October 2024

Вики-энтузиасты запустили инструмент по борьбе с ложными ИИ-статьями

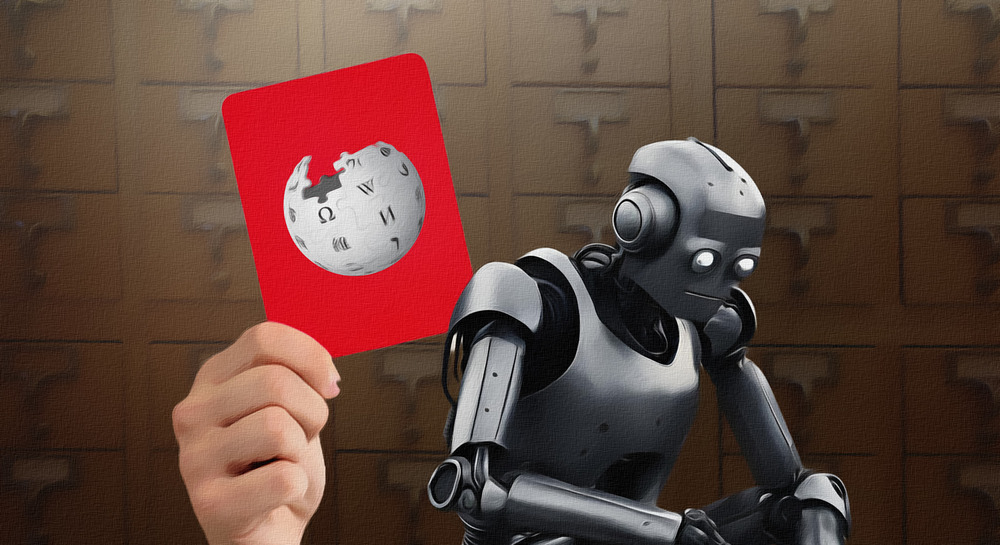

Сообщество «Википедии» столкнулось с новой проблемой — наплывом фальшивых статей, сгенерированных при помощи искусственного интеллекта (ИИ). Ложная информация, созданная нейросетями, стала появляться на платформе с пугающей регулярностью. Группа энтузиастов, которые входят в сообщество википедистов, для решения этой проблемы решили объединить свои усилия в рамках проекта WikiProject AI Cleanup. Целью этого проекта стало выявление и удаление ложных материалов, попавших на сайт благодаря ИИ.

Один из основателей проекта Ильяс Леблю рассказал, что команда столкнулась с фрагментами текстов, которые явно не были написаны человеком. Некоторые из этих материалов удалось в точности воссоздать с помощью ChatGPT, что подтвердило их искусственное происхождение. Например, была обнаружена статья о якобы существовавшей османской крепости под названием «Амберлисихар», якобы построенной в 1400-х годах. Эта статья содержала 2000 слов и выглядела достоверной, однако в реальности такой крепости никогда не существовало.

Не менее тревожным является факт, что злоумышленники внедряют ложные данные не только в новые статьи, но и в уже существующие. Так, в статье о жуке появился раздел, посвящённый виду крабов, причём с корректными ссылками на источники. Это затрудняет процесс выявления подделок, так как ложные данные могут выглядеть вполне правдоподобно.

Ещё один пример: статья «Ленинская историография» была полностью написана ИИ и ранее включала список полностью поддельных источников на русском и венгерском языках в нижней части страницы. Google не нашел результатов по этим источникам.

Проблема усугубляется тем, что любой пользователь может редактировать «Википедию». Это одна из причин, по которой многие учебные заведения не принимают работы, ссылающиеся на неё в качестве источника. Свободный доступ к редактированию даёт простор для злоупотреблений. Как отмечают специалисты, когда к платформе имеют доступ миллионы пользователей, даже небольшая доля тех, кто злоупотребляет системой, может создать серьёзные проблемы.

Пример использования ИИ в таких целях — не первый случай, когда технологии оказываются под ударом. Так, чат-бот Microsoft под названием Tay, запущенный в Twitter, был быстро отключён, когда начал генерировать оскорбительные и расистские сообщения. Современные ИИ-системы также подвергаются манипуляциям, как это уже было продемонстрировано в случаях с дипфейками и фальшивыми книгами на Kindle.

Создатели проекта по очистке «Википедии» признают, что полностью искоренить проблему будет непросто, так как ИИ продолжает развиваться, а злоумышленники находят всё новые способы внедрения ложных данных. Несмотря на это, группа энтузиастов намерена продолжать работу по очищению платформы и призывает к более тщательной проверке статей, а также к повышению осведомлённости пользователей о возможных угрозах.

WikiProject AI Cleanup станет важным шагом в борьбе с распространением ложной информации, однако его успех во многом будет зависеть от активности сообщества и его готовности к активному участию в процессе.

Кстати, в «Русской Википедии» на днях включили EditCheck. Теперь при добавлении в статьи большого куска текста без источников, автору предлагается указать их. Если он этого не делает, то статья метится особым образом и помещается в специальный список, где добавленный большой кусок текста уже перепроверяется другими участниками. «В целом, это должно сильно упростить отлавливание копипаста и GPT-текстов», — отмечают википедисты.

Similar articles

Our newsletter

The main news of the week in the field of law.

Contacts

18+

On December 23, 2022, the Ministry of Justice included Roskomsvoboda in the register of unregistered public associations performing the functions of a foreign agent. We disagree with this decision and are appealing it in court.