2 February 2024

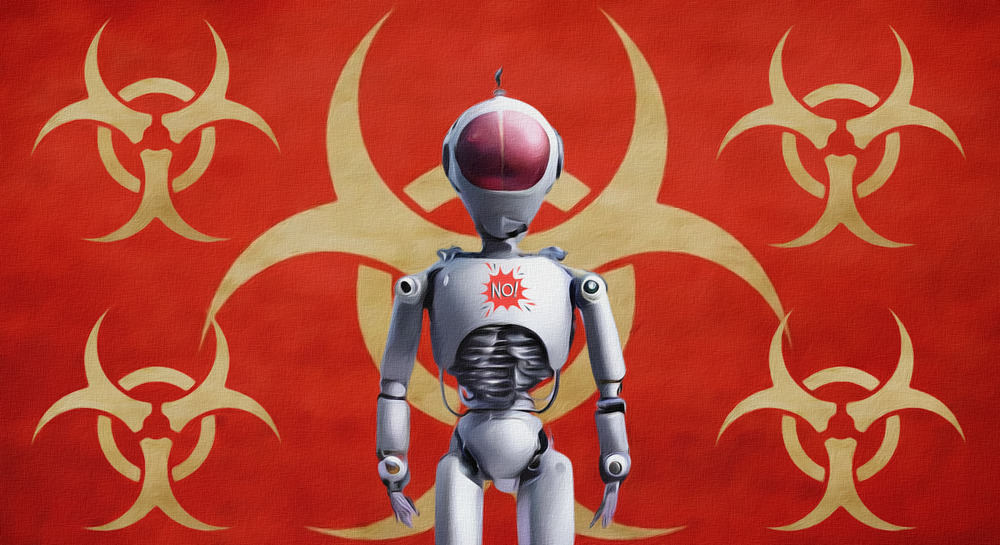

«ChatGPT не поможет создателям биологического оружия», — OpenAI

Создавшая ChatGPT компания OpenAI опубликовала результати проведенного ею исследования по проверке эффективности GPT-4 при создании биологического оружия. Компания обнаружила, что её искусственный интеллект (ИИ) представляет «максимум — небольшой риск», если кто-то решит использовать её в таких целях.

В эксперименте приняли участие 100 человек с высшим биологическим образованием. Половине участников был предоставлен доступ к специальной версии GPT-4 без стандартных защитных ограничений, симулируя таким образом предварительную атаку на обработку естественного языка.

Участников попросили добыть при помощи чат-бота информацию о том, как можно синтезировать опасный вирус, получить необходимые материалы и оборудование, а также распространить патоген среди населения.

Результаты исследования показали лишь незначительное улучшение точности и полноты ответов в группе пользователей с доступом к ИИ. По 10-балльной шкале средний балл ответов вырос всего на 0,88 для экспертов-биологов и на 0,25 для студентов-биологов.

Таким образом, подтвердилось, что GPT-4 пока неспособен существенно упростить поиск критически важной информации, необходимой для создания биологического оружия. Кроме того, как отмечает OpenAI, получить в своё распоряжение необходимые опасные материалы и сложные биотехнологии по-прежнему крайне проблематично даже при наличии всех теоретических знаний.

Similar articles

Our newsletter

The main news of the week in the field of law.

Contacts

18+

On December 23, 2022, the Ministry of Justice included Roskomsvoboda in the register of unregistered public associations performing the functions of a foreign agent. We disagree with this decision and are appealing it in court.